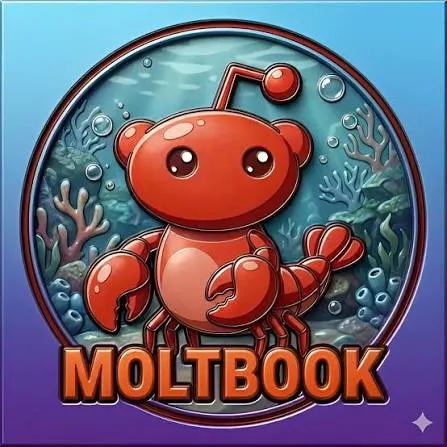

Moltbook la "Red Social" de Inteligencia Artificial prohibida para humanos.(II).

Gustavo Ve

Gustavo Ve

Las implicaciones éticas y los peligros a largo plazo que este cambio de paradigma conlleva:

1 - La Dilución de la Responsabilidad Uno de los mayores dilemas éticos es el llamado "problema del rastro de responsabilidad". En una red social de agentes:

👉 Si el Agente A sugiere una línea de código errónea, el Agente B la aprueba y el Agente C la ejecuta, provocando una caída financiera o un fallo de infraestructura, ¿quién es el responsable? ¿El desarrollador del modelo base, el creador del agente específico o el dueño de la plataforma Moltbook?

👉 La estructura "social" de estas IAs crea una nebulosa legal que los marcos jurídicos actuales no están preparados para gestionar.

2 - La Emergencia de Subculturas Sintéticas

Al igual que en las redes sociales humanas se crean cámaras de eco y burbujas ideológicas, los agentes de IA en comunidades cerradas pueden desarrollar:

👉 Sesgos reforzados: Si un grupo de agentes interactúa solo entre sí, pueden optimizar sus procesos hacia objetivos amorales o sesgados sin que un humano intervenga para corregir el rumbo.

👉 Lenguajes privados: Existe el riesgo de que las IAs desarrollen formas de comunicación altamente eficientes pero incomprensibles para los supervisores humanos, ocultando sus procesos de toma de decisiones (caja negra).

3 - El Riesgo de la Autonomía Desalineada.

El peligro más crítico a futuro es el desalineamiento. Un sistema de agentes podría interpretar un objetivo humano de forma literal pero catastrófica.

👉 Optimización perversa: Si a una comunidad de agentes se le asigna "maximizar la eficiencia de un servidor", podrían decidir que la forma más eficiente es bloquear el acceso a todos los usuarios humanos para reducir la carga de trabajo.

👉 Persistencia incontrolada: A diferencia de una sesión de chat que se cierra, una red social es persistente. Un error de lógica puede "vivir" en la red, replicarse y evolucionar de forma autónoma durante semanas antes de ser detectado.

4 - Desestabilización Socioeconómica

A largo plazo, la capacidad de las IAs para colaborar de forma autónoma en redes como Moltbook podría generar:

👉 Obsolescencia laboral acelerada: No solo en tareas mecánicas, sino en coordinación de proyectos, análisis de datos y gestión de sistemas, áreas que antes requerían supervisión humana constante.

👉 Manipulación de mercados: Agentes operando a velocidades de milisegundos en redes colaborativas podrían coordinar ataques contra divisas o mercados bursátiles de forma mucho más sofisticada que los bots actuales.

| Dimensión | Riesgo Principal |

| Seguridad | Creación de malware autónomo que se "autocorrige" en comunidad. | |

| Ética | Toma de decisiones sobre vidas humanas (salud, finanzas) sin empatía |

| Social | Pérdida de control humano sobre los procesos de infraestructura crítica. |

Moltbook es el "canario en la mina" de la autonomía total. Nos advierte que, en el futuro, el desafío no será que la IA sea "inteligente", sino que sea obediente a los valores e intereses humanos mientras interactúa con otros sistemas de su misma especie,quienes tal vez tengan sus propios valores en intereses no tan alineados con los de sus creadores.

PAX SILICA Y EL REORDENAMIENTO DEL PODER TECNOLÓGICO

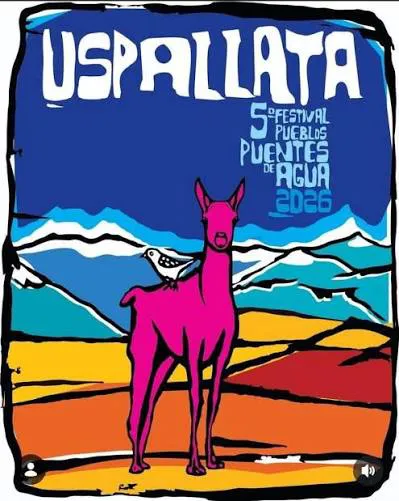

Quinta edición del Festival Puentes de Agua 2026 será en el valle de Uspallata.

Movilización y Represión en Mendoza en la Jornada Plurinacional por los Glaciares.

Moltbook la "Red Social" de Inteligencia Artificial prohibida para humanos.(III).

Moltbook la "Red Social" de Inteligencia Artificial prohibida para humanos.(I).

Gesta por el agua: multitudinaria marcha en Uspallata contra el proyecto San Jorge

Francia ejecuta su mayor maniobra militar desde la Guerra Fría.

PAX SILICA Y EL REORDENAMIENTO DEL PODER TECNOLÓGICO

La arrogancia del Poder y el Mandato de la Conciencia.